凌晨两点,编译器在优化你的代码。

它看到一个函数调用,小函数,就两行。它把函数体"展开"塞进调用点,省掉了一次函数跳转。然后它继续往下看,看到一个接口调用——停下了。它不知道运行时拿到的是哪个具体类型,没办法展开,只好老老实实做动态分发。

同一个加法操作,编译器"看得懂"和"看不懂",性能差了好几倍。

这不是夸张。这是我实测的数据:直接调用一个小函数,262 纳秒;同样的逻辑通过接口调用,1478 纳秒。代码做的事一模一样,编译器的"视野"不同,结果天差地别。

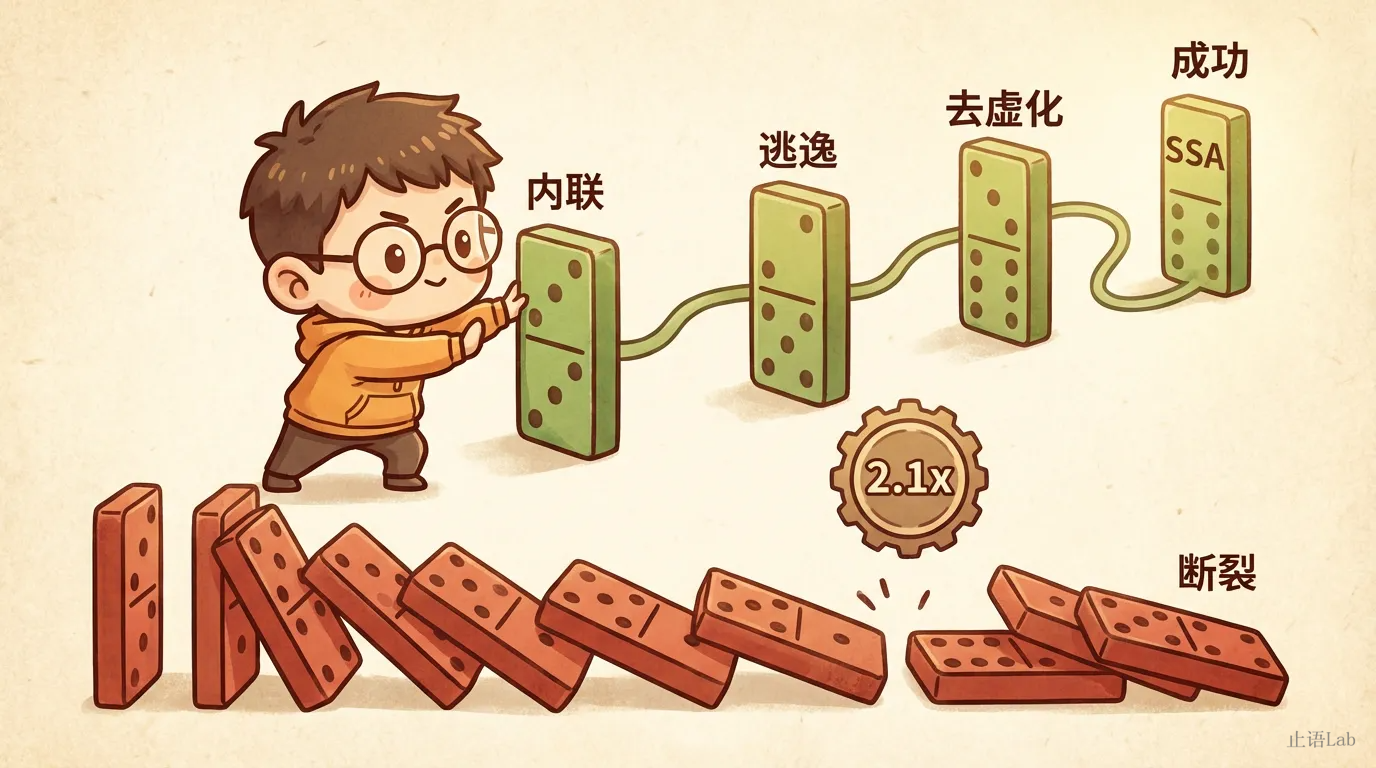

你可能觉得这是编译器的事,跟你写代码的方式没关系。但事实是:你的每一行代码都在决定编译器能"看见"多少。内联、逃逸分析、边界检查消除,这些优化不是独立发生的,它们像多米诺骨牌一样一环扣一环。一环断,全链断。

这篇文章不讲"编译器能做什么"——这种文章已经够多了。我讲的是另一个方向:编译器什么时候帮不了你,以及你怎么写代码,才能让编译器看得懂。

全文分六步:内联的边界 → 逃逸分析的边界 → 优化链(核心)→ 编译器盲区 → 写给编译器看的代码。

一、编译器怎么"看"你的代码

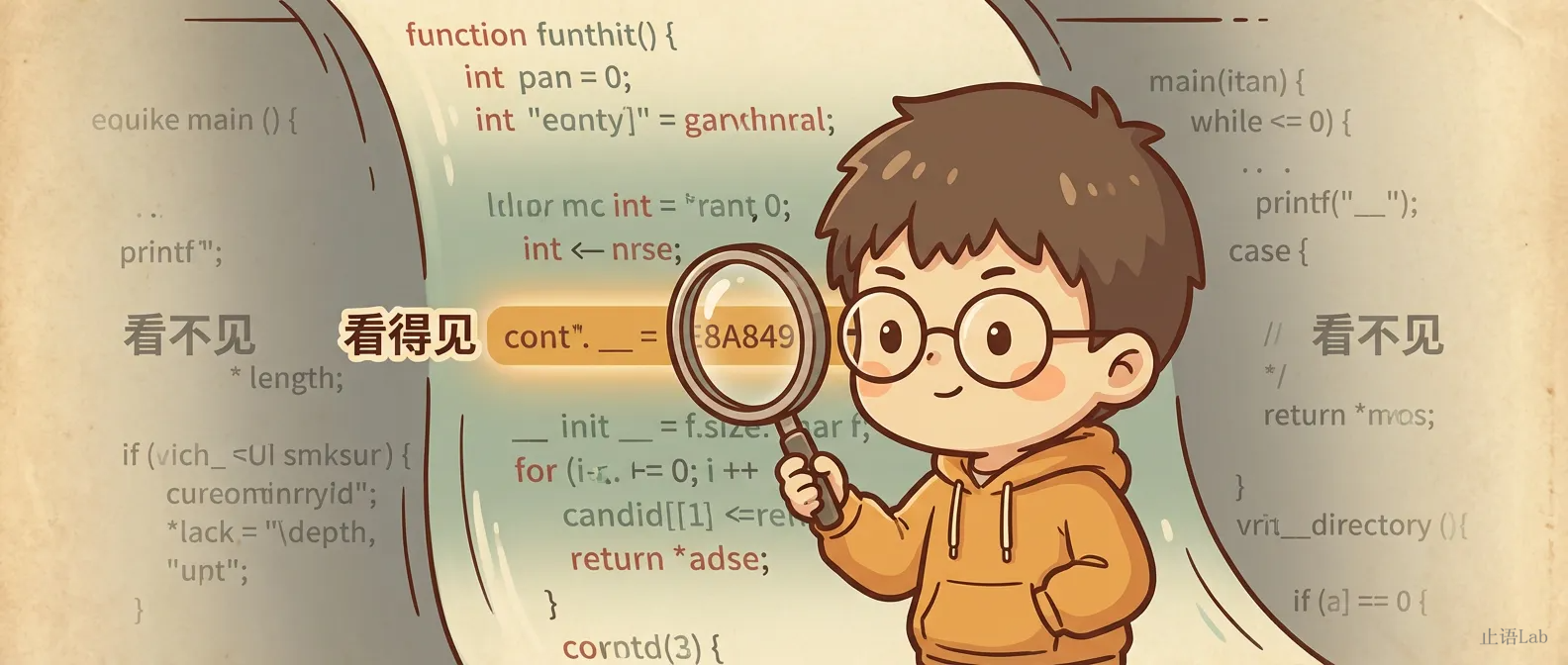

想象编译器是一个戴着眼镜的小家伙,坐在你的代码前面仔细阅读。它有一盏手电筒——光圈照到的地方,它看得清清楚楚;光圈外面,一片漆黑。

这盏手电筒的光圈大小,取决于你写代码的方式。

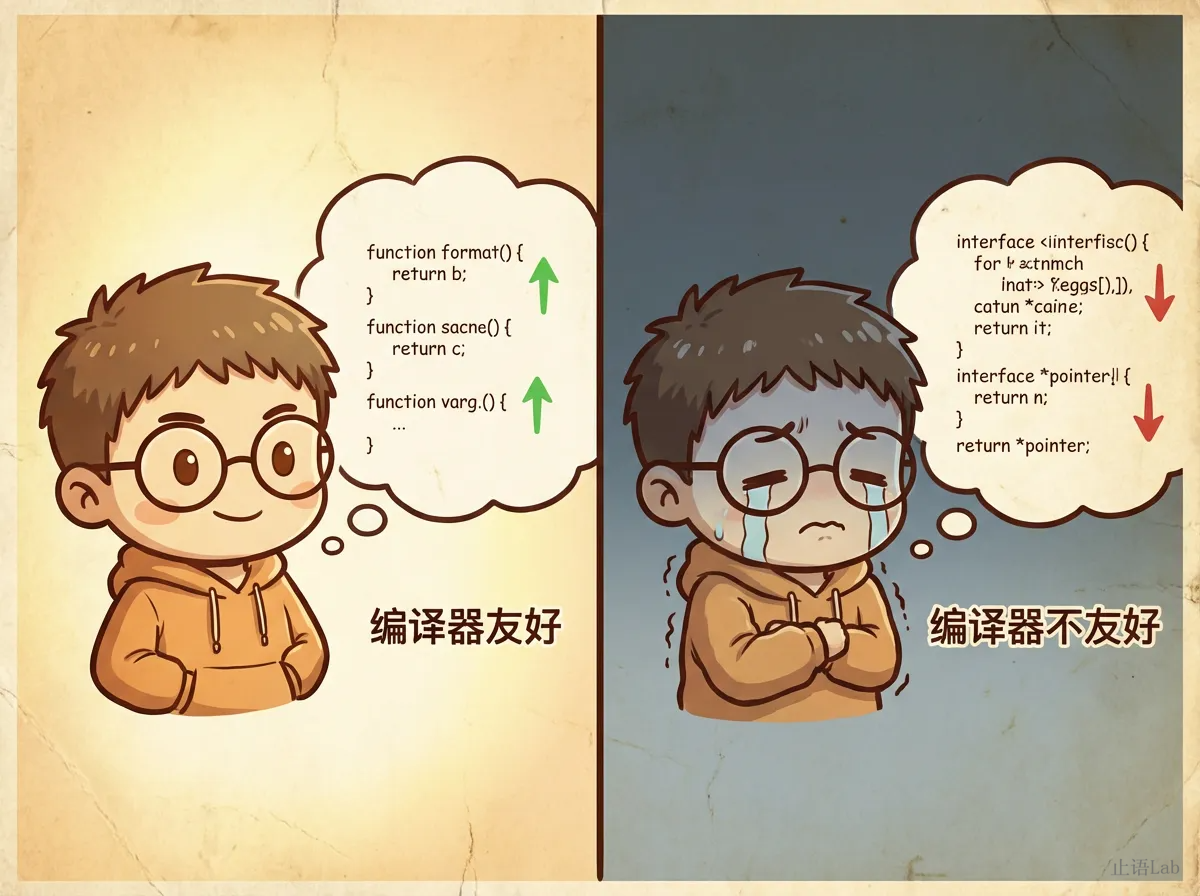

函数很小、逻辑简单?光圈够大,编译器一眼看穿,顺手就优化了。函数里有接口调用、闭包、反射?光圈突然变窄,编译器看不清上下文,只能做最保守的选择。

关键在于:编译器的每一个优化决策,都建立在"我看到了什么"的基础上。它看到的上下文越多,能做的优化越多;看到的越少,越保守。

有人会说:“过早优化是万恶之源。“没错——但理解编译器不是过早优化。了解交通规则不是让你开快车,是让你不在该刹车的时候踩油门。写编译器友好的代码,是"写对的前提下不浪费编译器能力”。

那编译器到底能看懂什么,看不懂什么?

二、内联——编译器最爱的优化

编译器最想做的一件事,是把函数调用"展开”。

你写了一个 add(a, b int) int,只有一行 return a + b。它看到调用 add(x, y) 的地方,直接把函数体塞进去,变成 x + y。函数调用的开销,压栈、跳转、返回,全部消失了。

这叫内联(inlining)。它是编译器最基础也最爱的优化。

但它不是什么函数都能内联。它有预算。Go 编译器给每个函数算了一个"复杂度分数",分数太高就不内联——预算有限,不能无限制展开。更关键的是,有些代码模式直接让内联变得不可能。

我跑了一组对照实验:

|

|

用 -gcflags="-m" 看编译器的决策:

|

|

Benchmark 数据更直白:

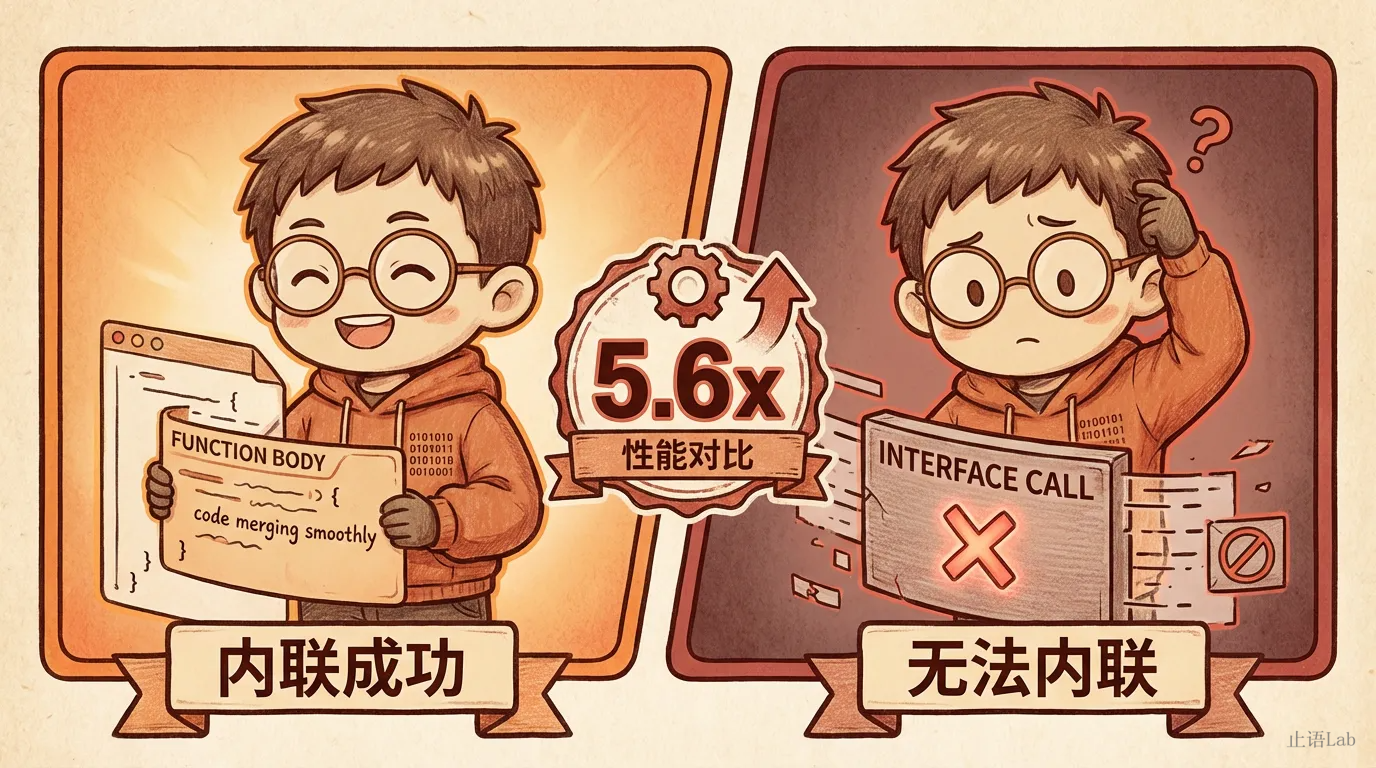

| 写法 | ns/op | allocs/op |

|---|---|---|

| 直接调用(内联) | ~262 | 0 |

| 接口调用(不内联) | ~1478 | 0 |

(测试环境:Go 1.26,Apple Silicon M4 Pro,单次 benchmark 取中位数)

5.6 倍差距。逻辑完全一样,allocs 都是零——差异纯粹来自分发方式。

这可能让你觉得奇怪:新版 Go 不是有去虚化(devirtualization)吗——从 Go 1.22 开始,编译器就能交错执行去虚化和内联了。确实有。编译器"猜到了"接口背后的真身——这叫去虚化。当它看到 var p Processor = fastProcessor{} 这种具体类型赋值时,它会自动去虚化:devirtualizing p.Process to fastProcessor,然后内联,零开销。

但去虚化有个前提——它得"看见"具体类型。如果类型从 slice、map、channel 里取出来,编译器在编译期无法确定运行时拿到的是哪个,去虚化就失败了。

所以不是"用接口就慢",是"编译器看不清具体类型就慢"。

三、逃逸分析——栈还是堆?

我在跑 benchmark 时发现一件怪事:同一个函数,加了 //go:noinline 就逃逸到堆上,不加就不逃逸——编译器在帮你"作弊"。

先不急着解释,看基础知识。看完函数后,要决定变量放哪:栈还是堆。

栈分配几乎免费,函数返回时自动回收。堆分配就麻烦了:GC 要扫描、标记、清理,每次都要走一遍。

它用逃逸分析(escape analysis)做这个决策:变量寿命不超过函数返回,放栈上;变量"逃出"了函数——被返回指针引用、被闭包捕获、被塞进接口:必须放堆上。

我实测了几种常见场景:

|

|

Benchmark:

| 写法 | ns/op | allocs/op | vs 栈分配 |

|---|---|---|---|

| 值返回(栈) | ~0.74 | 0 | 1x |

| 返回指针(堆) | ~6.6 | 1 | ~9x |

| 闭包捕获(堆) | ~7.8 | 1 | ~10.5x |

💡 栈分配 vs 堆分配:近 10 倍差距——这就是为什么逃逸分析这么重要

9 到 10 倍差距(这是单个 int 的极端场景,真实业务中 struct 的差距通常小得多)。如果你的热路径上有大量小对象的堆分配,GC 压力会成倍增加——更多堆分配意味着更频繁的 GC,更频繁的 GC 意味着更多 CPU 时间花在回收上。

栈和堆的差距一目了然。但回到开头那个怪事——

不加 //go:noinline 时,上面所有"应该逃逸"的函数,benchmark 里都是 0 allocs。 为什么?因为函数被内联后,编译器看到的上下文变了——变量不再"逃出"函数边界,逃逸分析自然就把它放回栈上了。

这不是 bug,是特性。它恰好证明了下一章的核心概念——优化链。内联失败,逃逸分析就更保守,更多变量被迫分配到堆上。

想知道编译器对你的代码做了什么逃逸决策?一行命令:

|

|

输出里 does not escape 是好消息,escapes to heap 或 moved to heap 要注意。

四、优化链——一环断,全链断

内联、逃逸分析、接口去虚化——前面三章各讲了一个。但你可能没意识到,它们之间有一条暗线。

Go 编译器的优化不是六个独立的开关,是一条链。内联在前面,为后续所有优化提供上下文。内联成功,它看到更多,逃逸分析更精确,去虚化可能生效,后续 SSA pass 有更多素材。内联一旦失败,上下文就丢了。后面的逃逸分析只能做最保守的假设,去虚化也找不到入口,SSA pass 拿到的素材就少了——整条链从源头断开。

Go 官方源码 cmd/compile/internal/ssa/compile.go 里,核心 SSA pass 按固定顺序执行(实际有几十个,这里只列关键的):

|

|

注意,内联和逃逸分析不在 SSA 管线里——它们在更早的编译阶段完成(编译器先做内联和逃逸分析,再进入 SSA 优化管线)。SSA 拿到的已经是经过内联和逃逸分析后的代码。前端优化为后端优化铺路,一环扣一环。

我跑了一组实验来验证这个链式传导:

|

|

结果:

| 场景 | ns/op | allocs/op | vs 基准 |

|---|---|---|---|

| 纯直接计算(最优) | ~485 | 0 | 1x |

| 优化链完整 | ~488 | 0 | ~1x |

| 优化链断裂 | ~1043 | 0 | ~2.1x |

优化链完整版几乎等于手写直接计算——内联让函数调用"消失"了。优化链断裂版慢了两倍,不是因为某个优化没做,而是因为第一个优化(内联)失败了,后面一串都跟着失效。

这就是"一环断,全链断"。严谨地说,2.1 倍的差异里有多少来自内联失败本身、多少来自逃逸分析变保守,本文没有逐一拆解——但方向是明确的:源头断了,下游必然受影响。

旁注:边界检查消除(BCE)。Go 每次访问数组/切片都做边界检查,但编译器的

provepass 会尝试证明索引一定在范围内,证出来就消掉检查。BCE 本身性能收益不大(现代 CPU 分支预测器很强),但消除检查减少了代码体积,且在不同架构上收益可能不同。更重要的是,BCE 依赖前面的 CSE pass 提供基础——又是链式依赖的一环。查看命令:go build -gcflags="-d=ssa/check_bce" ./...

五、编译器的盲区

编译器也有它看不清的地方——有些是权衡,有些是暂时的限制。

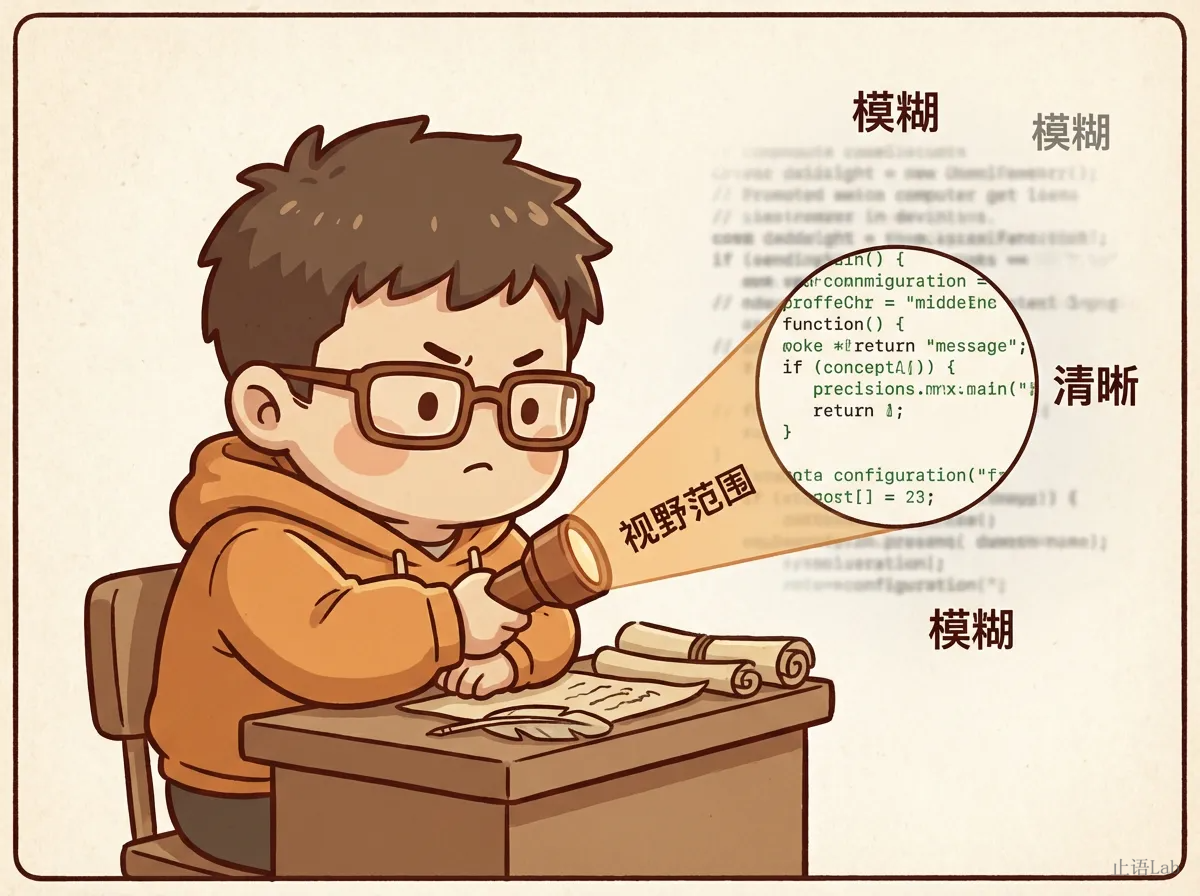

接口:手电筒照到黑盒

这是最常见的盲区。前面实验已经证明了:当编译器无法确定接口的具体类型时,接口调用无法去虚化,也无法内联。手电筒照到黑盒,看不清里面。

但有一个例外:PGO(Profile-Guided Optimization)。Go 1.21 正式支持了 PGO(1.20 为预览版),通过运行时 profile 数据告诉编译器"这个接口调用 99% 走的是 A 类型",编译器可以据此做推测性去虚化,打开内联机会。Uber 的生产环境实测整体性能提升约 4%(来源:Uber Engineering Blog, 2025年3月),合成基准测试中甚至达到 10%-12%。4% 听不多,但在大规模服务上意味着节省数十台机器。

不过 PGO 是另一个话题了,对大多数个人开发者来说,更实际的方法是:在热路径上避免通过接口调用小函数。不是不用接口,是别在每秒百万次调用的循环里用。

泛型:手电筒照到毛玻璃

Go 的泛型目前采用 GC shape stenciling + 字典实现。编译器按 GC 形状(指针类型 vs 值类型)生成多份代码,但同一 GC 形状内的不同具体类型共享代码,通过字典在运行时查找类型信息。手电筒照到毛玻璃——轮廓在,但细节糊了。

这意味着编译器在编译期仍看不到每个具体类型的完整信息,很多优化做不了。在 Go 1.26 中,泛型函数的优化确实受限。目前没有公开的改进时间表,但这不是永久限制——GC shape stenciling 本身就是从 Go 1.18 到 1.26 逐步改进的结果。

反射:手电筒被关掉了

反射是编译器最头疼的东西。通过反射调用方法,内联、逃逸优化、去虚化全部失效——手电筒被关掉了。datasea 在《Go反射无法内联、无法逃逸分析、无法被SSA优化》中做了深度拆解,这里不展开。

关键不是"不能用反射",是用在哪——序列化/反序列化的热路径上用反射是灾难,启动初始化时用反射无所谓。

六、写给编译器看的代码

还记得开头那个凌晨两点的编译器吗?现在你知道它为什么在接口调用前停下了。

那怎么写代码,才能让编译器看得懂?

原则一:热路径上的小函数,保持简单。

函数越简单,内联预算越够用(默认预算 80 个节点,函数里的表达式、控制流都会消耗预算)。一个只有 return a + b 的函数,编译器闭着眼都能内联。加复杂循环、多重分支,预算就不够了。热路径上的核心计算函数,能短则短。用 -gcflags="-m -m" 能看到每个函数的复杂度分数。

原则二:接口用在大边界,不要用在循环里。

接口是 Go 的核心抽象,不是不用。但接口调用的动态分发有代价。在"模块间通信"的大边界用接口完全合理,在每秒百万次的循环内部用接口调用小函数就不合理了。

原则三:不要为了"灵活性"返回指针。

func getX() *int 看起来比 func getX() int 更灵活,但编译器必须把 x 分配到堆上。如果调用方不需要修改返回值,值返回就够了。对于小值类型,返回指针的代价远超那点灵活性。但大 struct 要实测——值拷贝本身有开销,有时候返回指针反而更快。

最重要的方法论:验证,不要猜。 编译器的优化决策不是秘密,一行命令就能看到:

|

|

不要背规则——Go 编译器每个版本都在变。今天不能内联的函数,下个版本可能就可以了。记住验证方法,比记住一百条优化技巧管用。

原则五:编译器盲区有替代方案。

泛型场景可以用代码生成替代反射,热路径上用具体类型替代接口,必须用反射时限制在初始化阶段。这些不是你写错了代码,是编译器当前的客观限制——承认它,绕过它。

明天写代码之前,跑一下 -gcflags="-m",看看凌晨两点的编译器,是不是真的看得懂你的代码。