凌晨2点17分,一个开源日志库的维护者收到一条GitHub Issue——某个用户报告,在特定输入模式下,日志解析器会产生异常的内存行为。他白天是后端工程师,晚上和周末维护这个周下载量200万的库。整个项目只有3个兼职维护者,没有人是安全专家。

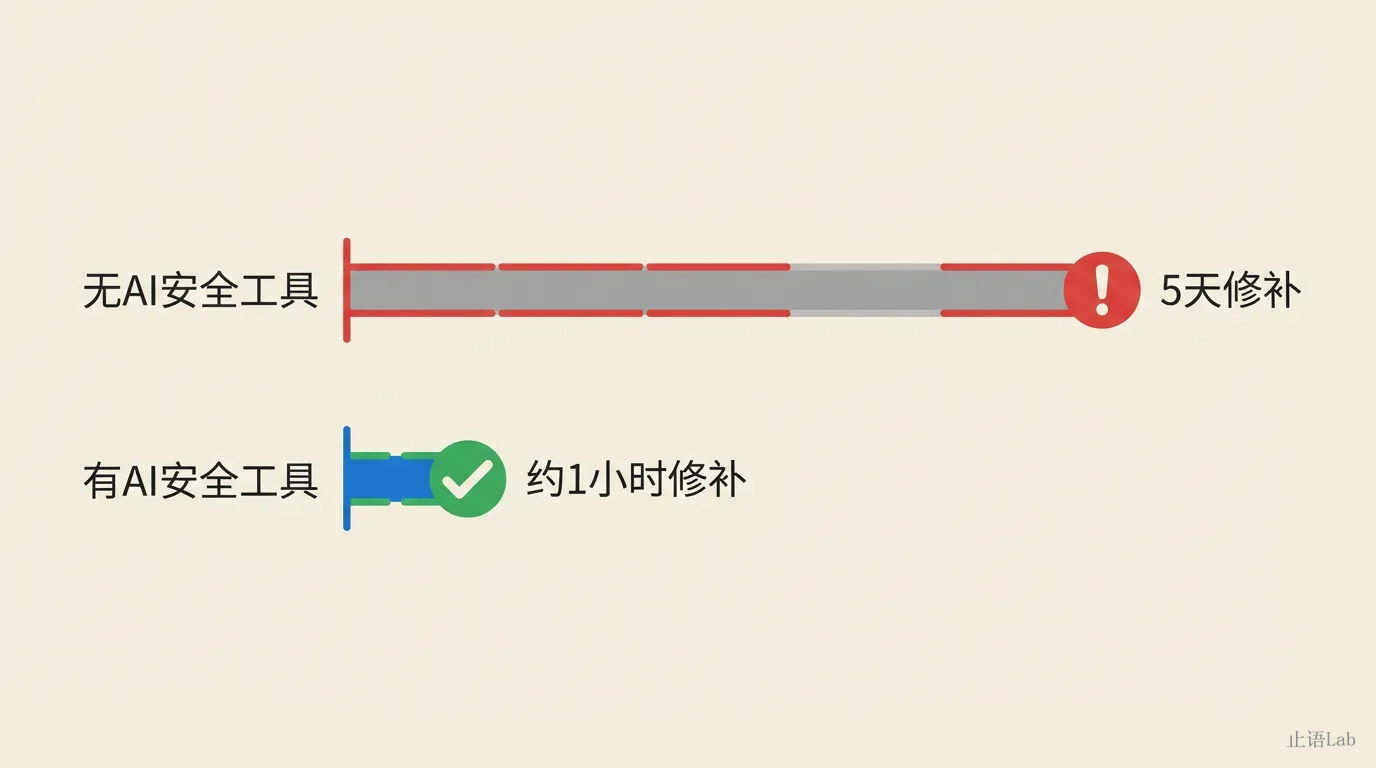

同一天,同一个类型的漏洞,Mythos可以在13分钟内完成分析:攻击面评估、利用路径、修补方案。但Mythos不属于他。他能做的,是手工审计代码,在5天后确认这是一个可利用的高危漏洞。

5天和13分钟——大约550倍的差距。这是结构性鸿沟,不是个人努力的差距。

一个反直觉的事实:最强的AI安全工具,恰恰对最需要它的人不可及。

一、Glasswing的"透明"对谁透明?

2026年4月,Anthropic发布了Project Glasswing——一个用AI模型Mythos加固全球关键软件的安全计划。使命声明很明确:用最强的AI安全能力保护最重要的软件。

但仔细看合作伙伴名单,你会发现一个有趣的模式。12家创始合作伙伴:Amazon、Apple、Broadcom、Cisco、CrowdStrike、Google、JPMorganChase、Microsoft、NVIDIA、Palo Alto Networks,加上Anthropic自己和Linux Foundation。另有40多家受邀组织获得了访问权限。

无一中小企业,无一独立安全研究者。

Anthropic承诺了1亿美元的使用额度覆盖研究预览期,预览期结束后定价为$25/百万输入token、$125/百万输出token。表面看,这个价格在中小安全团队的预算范围内。但关键不是价格——是资格。

Mythos不计划公开发布(Anthropic官方声明:“We do not plan to make Claude Mythos Preview generally available”)[1]。它只对Glasswing合作伙伴和受邀组织开放。开源维护者需要通过Claude for Open Source项目申请,获得的是标准Claude的访问权限,不是Mythos的网络安全特化能力。

标准Claude和Mythos之间的能力差距是显著的。根据Anthropic发布的数据[1],Mythos在CyberGym漏洞复现测试中得分83.1%,Opus 4.6是66.6%;SWE-bench Verified是93.9%对80.8%。差距真实存在——不过,Opus 4.6已经能发现约2/3的漏洞,Mythos的额外16.5个百分点覆盖的是更隐蔽、更复杂的漏洞模式。对于没有AI工具的维护者来说,差距不是83.1%和66.6%之间,而是0%和83.1%之间。

Anthropic还向开源安全组织捐赠了400万美元(Alpha-Omega 250万、Apache基金会150万)[1]。实实在在的支持。不过,400万美元捐给组织,维护者仍然没有获得Mythos的直接访问。基金会拿到钱可以雇审计师,但审计师做完就走,维护者的自主安全能力并没有增长。

钱可以转手,能力不可替代。 捐赠是输血,直接访问是造血。安全鸿沟的缩小,最终要靠维护者自己拥有工具。

二、递归矛盾:安全限制如何制造新不安全

到这里,你可能会反驳:限制访问有合理的安全理由——Mythos太强了,万一被恶意使用怎么办?

这个反驳是对的。但只对了一半。

让我们一步步看。

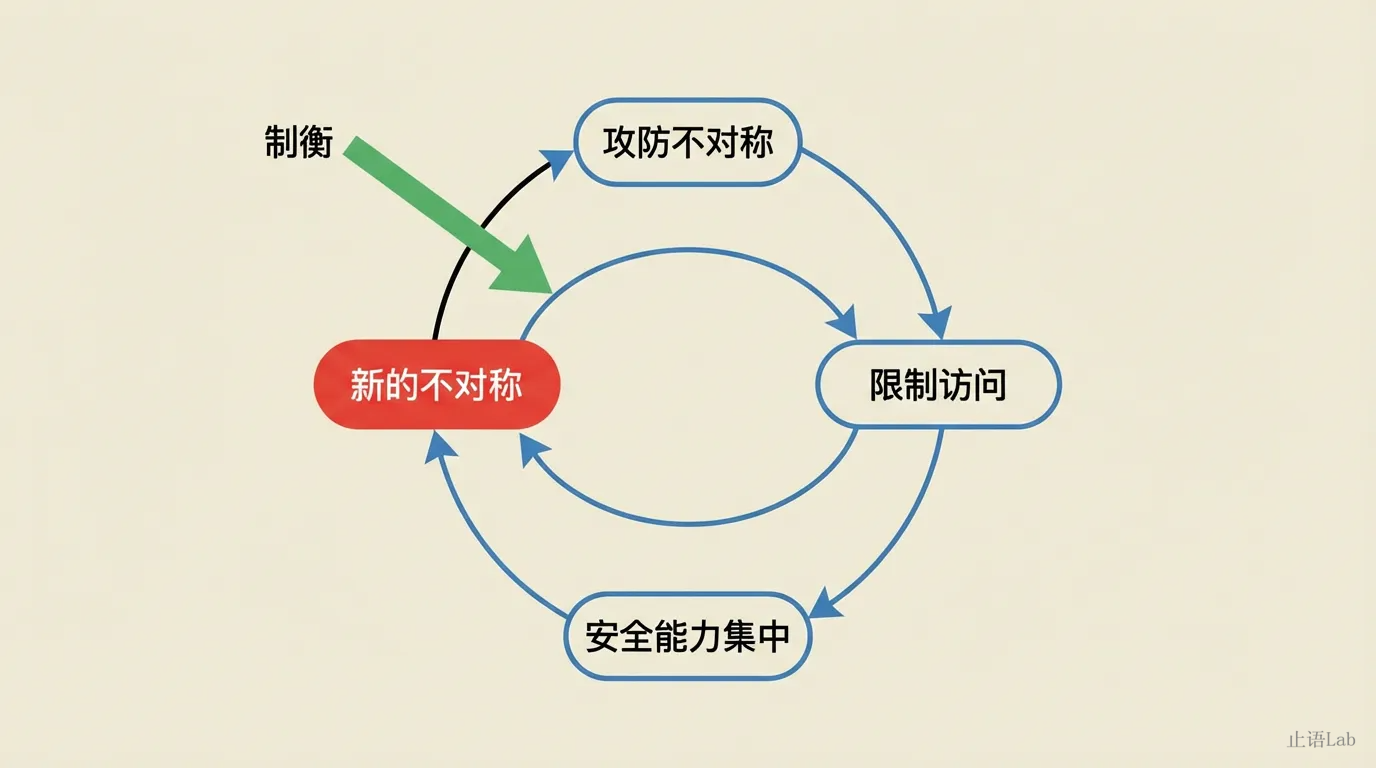

第一步:攻防不对称 → 限制访问合理。 AI安全模型确实可能被用于自动化漏洞利用。攻击者拿到Mythos的后果,比防守者拿到的收益更难控制。Anthropic的"负责任扩展政策"要求对高风险能力实施访问控制——这是理性决策,不是错误。

第二步:限制访问 → 安全能力集中 → 新的不对称。 这一步是转折。当只有12家巨头和40多家受邀组织拥有最强安全能力时,发生了什么?获得能力的机构更快发现自己的漏洞,更快修补。未获得能力的群体——占软件供应链绝大多数的开源维护者和中小团队——安全差距在扩大。

更关键的是,这种差距大概率是动态扩大的(这是推演,非实测)。大公司用AI安全工具修补自己的系统,整体威胁面缩小。但未修补的开源组件暴露相对更多——中小团队的攻击面不是保持不变,而是在相对增大。

第三步:如果没有制衡,新不对称可能强化限制。 这是递归的核心。在缺乏扩大受益面机制的情况下,安全事件频发容易被解读为"AI安全工具确实很危险,不能随便开放"——限制的理由被强化,安全能力更加集中。

限制制造了鸿沟,鸿沟可能被解读为限制的正当性——如果缺乏制衡,这就构成一个正反馈循环。

限制访问的理由本身,可能部分是限制访问的结果。 这不是一个必然闭环,是一个有条件的正反馈:如果缺乏扩大受益面的机制,循环会自我强化;如果存在制衡,循环可以被打破。

这不是简单的循环论证,是一个有条件的正反馈循环。每一次"限制→差距→事件→更多限制"的循环,都在加深安全能力的不平等——前提是没有人主动打破它。

要强调:这不是"限制=错误"的论证。限制在短期内有合理性,攻防不对称是客观事实。我想指出的是——限制如果不配合扩大受益面的机制,存在形成正反馈循环的风险。问题不在"限制还是开放",在于限制的设计是否考虑了分配公平。

三、开源维护者的安全盲区

回到开头那个维护者。他不是虚构的——他是成千上万兼职维护开源项目的人的缩影。

他发现一个疑似漏洞后,能做什么?手工审计代码,逐行检查输入验证逻辑。在3个文件间跳转,追踪输入路径。用搜索引擎查相似CVE,在NVD数据库里翻。这个过程要4-6小时,还不算确认漏洞严重程度的时间。

如果他有Mythos?输入相关代码,约13分钟完成攻击面评估和利用路径分析(基于当前AI安全分析能力的估算[1])。确认漏洞不需要5天——约13分钟。修补发布不需要6天——约1小时。

这不是个体能力问题。他是优秀的工程师,但安全审计不是他的专业。AI工具不是替代他的判断,是弥补专业差距。

时间就是安全。 5天和1小时的修补延迟差距,意味着漏洞持续暴露的时间不同。使用这个库的金融机构,在没有AI工具辅助时漏洞暴露5天,有AI工具时约1小时。安全工具的分配差距,最终由终端用户承担。

而且,这个差距不是靠"更努力"能弥补的。他可以更快、更拼命,但他无法在不借助工具的情况下把5天压缩到1小时。Mythos已经可以做到——只是不属于他。

四、不是二选一——分层治理的可能

批评容易,建设难。如果限制有问题,全开放就行吗?显然不是——攻防不对称是客观事实。

出路在"限制"和"开放"之间的广阔设计空间里。有四条线索指向同一个方向。

线索一:OpenSSF的捐赠模式——有效但不充分。 Alpha-Omega项目年度预算超过700万美元,2025年投资了14个关键开源项目,完成60多次安全审计,修复52个漏洞[2]。这很实在。但两个问题:第一,核心模式是"你缺安全,我帮你做"——维护者被动接受帮助,没有自主安全能力。第二,OpenSSF的治理结构本身就是大公司主导的——管理委员会19席中15席由Microsoft、Google、AWS、Apple等大型科技公司占据(截至2026年初数据)[2]。决策权和缴费金额直接挂钩,开源维护者在决策中几乎缺席。2026年3月,Anthropic、AWS、Google、Microsoft、OpenAI等又联合投入了1250万美元[2]。连Glasswing的合作伙伴都在资助开源安全——这恰恰说明当前的访问模式不够。

线索二:OSS-Fuzz的平台开放模式——更接近正确答案,但规模远远不够。 Google的OSS-Fuzz对任何开源项目免费提供持续模糊测试服务。模式从"授权访问"变为"平台开放"——项目可以自主申请接入,安全能力直接到维护者手中。截至2024年底,OSS-Fuzz已覆盖超过4000个项目[2],相对全球数百万开源项目,覆盖率仍然不到1%。平台开放是正确的方向,但规模远不足以填补安全鸿沟。

线索三:Oxford的公共品框架——理论基础。 2025年3月,Oxford和Concordia AI发布报告《Examining AI Safety as a Global Public Good》,论证AI安全具备公共品特征——知识层面的非排他性(一个人的安全知识不减少另一个人的)和非竞争性(安全知识可被所有人同时使用)。当然,这个类比不是完美的——API调用有速率限制,工具本身有成本,严格意义的非竞争性不成立。但在知识层面,漏洞发现的方法论、安全审计的经验、威胁模式的认知——这些一旦产生,不因为多一个人使用而减少。限制这些知识的流动,会损害整体安全水平,而不仅仅是不公平。

线索四:Glasswing自身的90天公开承诺——一个微小的制衡信号。 Anthropic承诺90天内公开发布漏洞修复情况和经验教训[1]。这意味着Glasswing的安全发现不会永远停留在12家合作伙伴内部——知识会流出,只是有延迟。这个承诺不是分层治理,但它说明:即使是最严格的限制方案,也在寻找知识流通的路径。

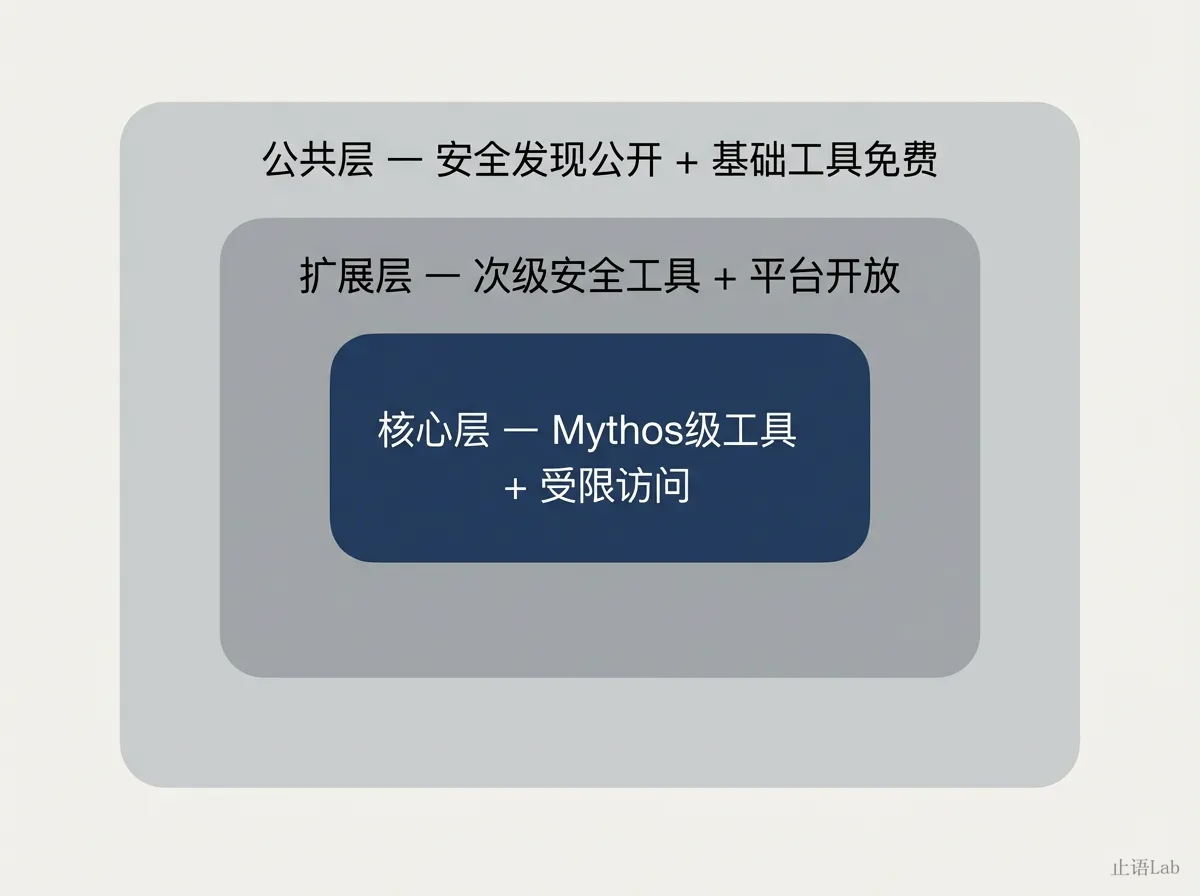

四条线索指向同一个方向:安全能力应该分层供给,而不是一刀切地限制。

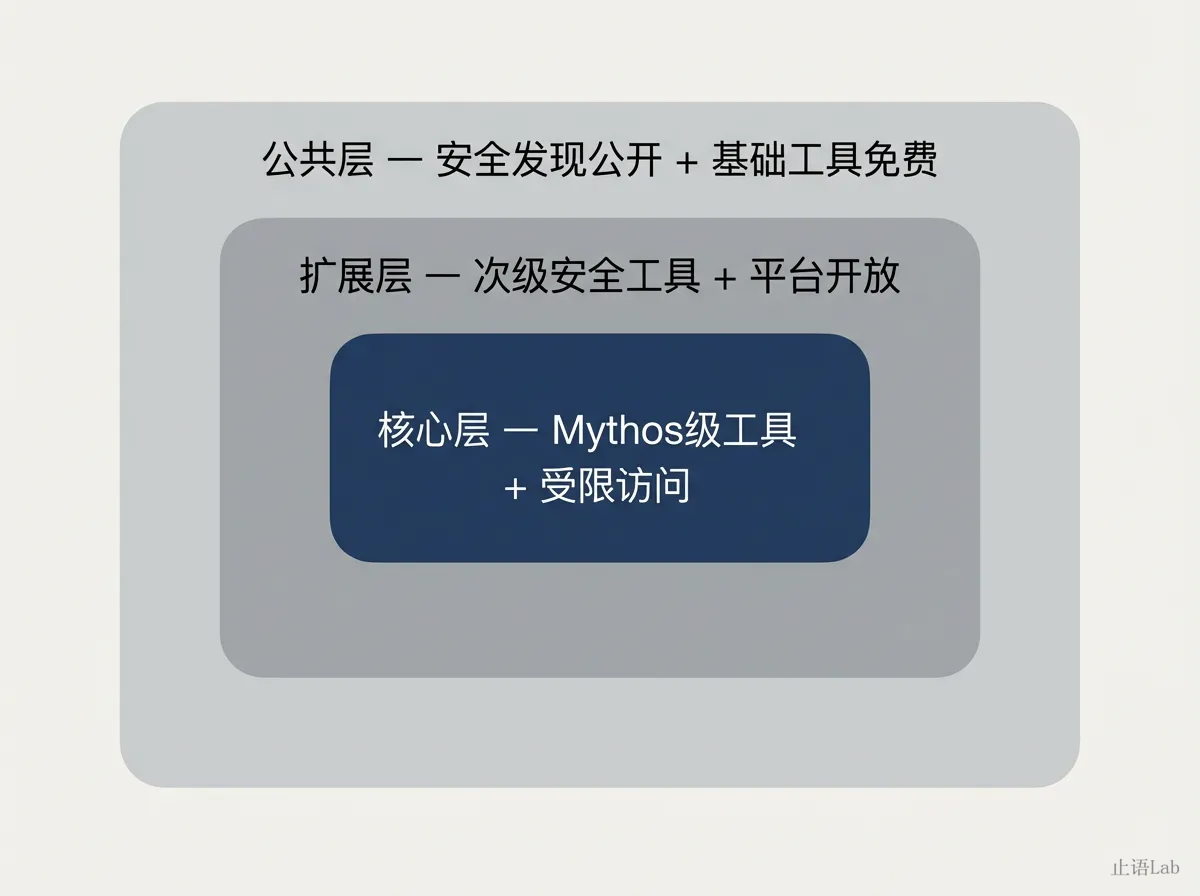

一个可能的框架:

核心层——Mythos级工具限于经验证的安全组织使用。维持安全理由,不改变核心限制。

扩展层——受审查的安全研究者、开源维护者获得次级安全工具。不是Mythos的全部能力,但足以做基本漏洞检测和评估。具体来说:类似OSS-Fuzz的模式,搭建一个"安全扫描平台"——维护者提交代码,平台用受控的AI模型做扫描,返回结果但不开放模型本身。平台开放,受监管但可及。Glasswing已有的"Cyber Verification Program"(安全专业人员受限通道)可以扩展为这个扩展层的入口。

公共层——安全发现强制公开共享(Glasswing已承诺90天内公开报告),基础安全工具免费开放。这是兜底保障。

三层不是完美方案,但它打破了递归矛盾的核心循环。

核心层维持安全理由,扩展层扩大受益面,公共层兜底保障。每一层都有安全能力的供给,限制不再制造单调扩大的鸿沟。

五、安全能力是公共品,不是特权

回到那个维护者。他代表了软件供应链中最脆弱也最关键的一环——全球99%的软件依赖开源组件,而维护这些组件的人大多没有安全资源。这个数字让我不安:最需要保护的人,恰恰最缺乏保护的能力。

AI安全能力像清洁水。基础公共卫生不应由少数供应商决定谁能喝到。你可以给水做净化处理,可以对用水做合理限制,但你不能把水龙头锁起来,只给12家公司发钥匙。

下次你看到一个安全工具只对部分人开放,问三个问题:

谁被排除在外? 如果排除的是软件供应链中最脆弱的环节,限制就在制造新的不安全。

有没有中间路径? 开放和封闭之间有设计空间。OSS-Fuzz证明了平台开放模式可行。

谁在定义"安全"? 安全标准的制定权本身需要审查。如果定义"什么是安全"的人,恰好是安全能力分配的受益者,那安全本身就值得审视。

安全恰恰是最不该过度集中的东西之一。

参考来源

[1] Anthropic, “Project Glasswing: Securing critical software for the AI era,” 2026年4月. https://www.anthropic.com/glasswing

[2] OpenSSF, “Leading Tech Coalition Invests $12.5 Million Through OpenSSF and Alpha-Omega to Strengthen Open Source Security,” 2026年3月. https://openssf.org/blog/2026/03/17/leading-tech-coalition-invests-12-5-million/