背景交代一下:我在生产环境跑过多个 Agent 系统,从单 Agent 到 Multi-Agent 编排都踩过,也参与过几个团队的技术面试。这个问题看到很多人在问,但多数回答停留在"学 LangChain 系列"层面,所以想说说我的判断。

一、市面上路线的问题在哪里

B 站和各平台的"AI Agent 入门"课,核心逻辑基本是:

安装 LangChain → 接 OpenAI API → 跑一个带工具的 ReAct 示例 → 做个 RAG demo → 完

它们只教你怎么跑起来,没有教你为什么会跑不起来。

真实的 Agent 系统会遇到什么?

- 模型输出格式偶尔不符合预期,整个工具调用链断掉

- 多步任务走到第 4 步突然 context 超长,不知道该截断哪里

- RAG 把不相关文档检索出来,答案看上去靠谱实际上是错的

- 生产环境的某条链路偶发失败,你连日志都不知道该看哪里

学完 LangGraph 还是不会处理这些。课程教的是 happy path,面试和生产要的是你怎么 handle unhappy path。

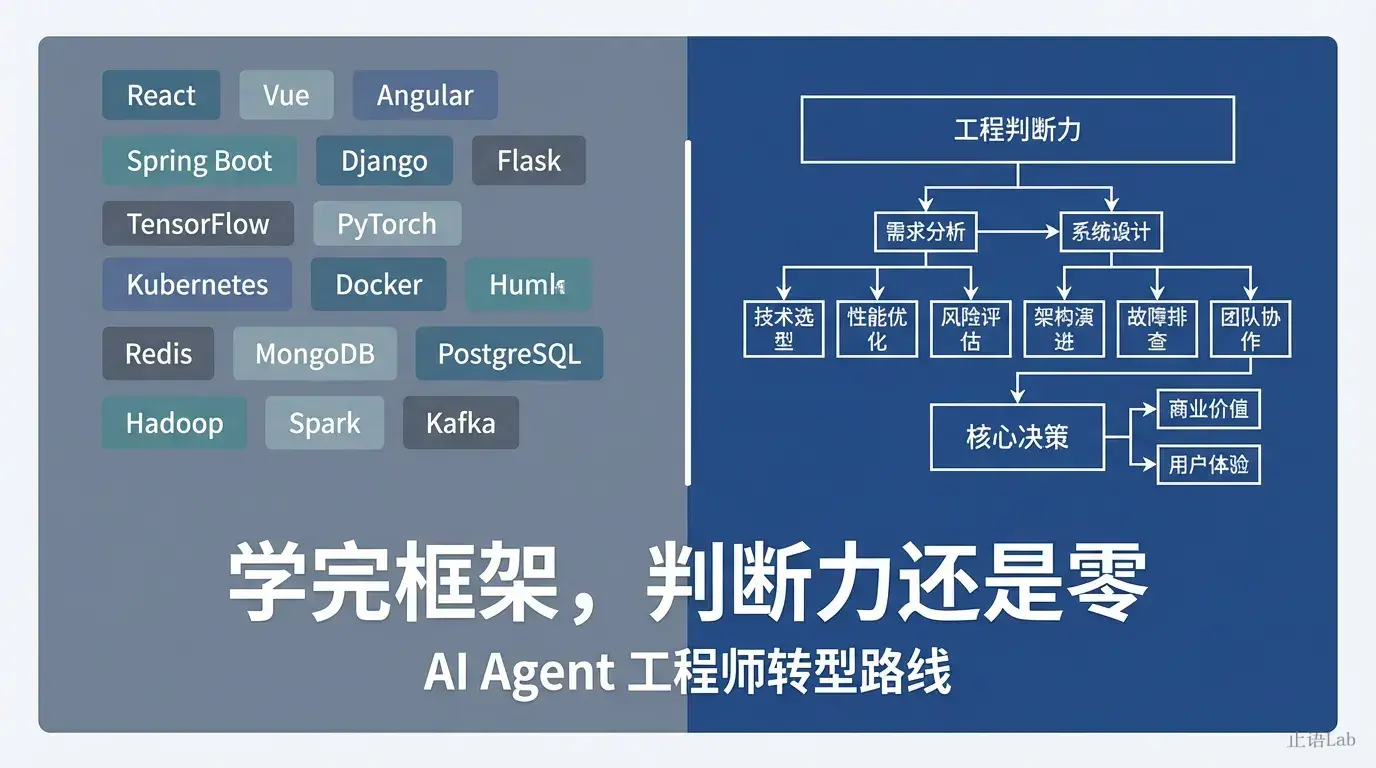

这不是框架问题,是工程判断力的问题。框架学完,判断力还是零。

二、你 6 年后端经验的真正价值

你比那些"先学 AI 的人"有一个核心优势——你知道系统会坏。

一个没有后端经验的人学 Agent,会把工具调用当成魔法,觉得它不出错是默认状态。一个 6 年后端会问:这里的重试逻辑是什么?失败了怎么降级?状态怎么持久化?这次调用幂等吗?

这些直觉在 Agent 工程里比学会某个框架更值钱。

你需要做的,不是从零开始学,而是把工程直觉迁移到 AI 这个新的不确定性来源上。

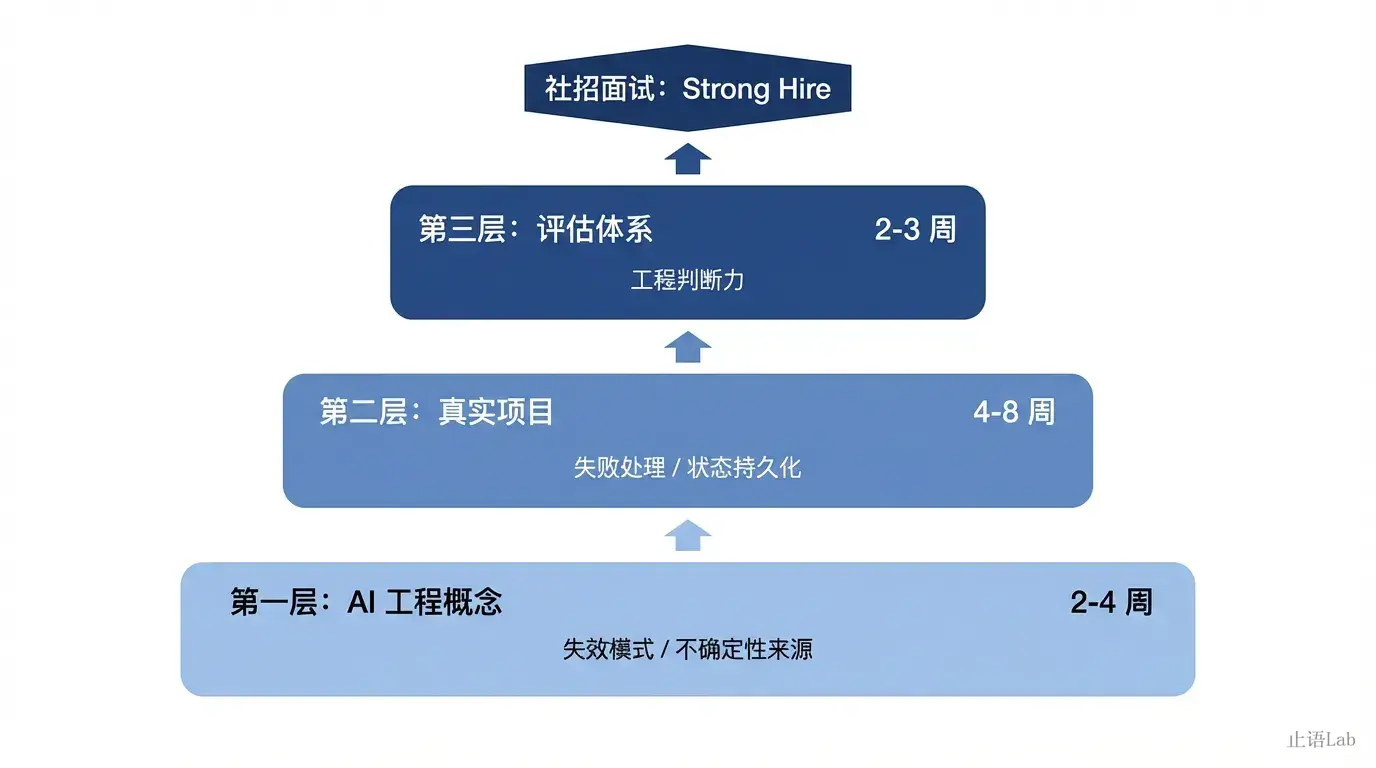

三、一条能过社招面试的自学路线

分三层,从下往上建:

第一层:补 AI 工程的特有概念(2-4 周)

只是补认知盲区,不是从头学。需要掌握的核心概念:

- LLM 的不确定性来源(temperature、token budget、上下文窗口边界)

- RAG 的基本原理和它的失效模式(向量召回率问题、分块策略影响)

- Agent 的三个设计模式:ReAct、Tool Use、Plan-and-Execute

- Prompt 工程的本质:结构化约束,而不是"好好说话"

不需要课程,读官方文档和几篇高质量的博客文章足够。重点是能说清楚每个概念在什么情况下会出问题。

第二层:用工程视角做一个真实项目(4-8 周)

不是"做一个 RAG 聊天机器人"那种,而是要带着以下问题去做:

- 这个 Agent 能做什么,做不到什么?边界在哪里?

- 它什么时候会出错?出错之后系统怎么恢复?

- 我怎么知道它的回答质量是否下降了?

具体项目方向:一个有明确失败处理机制的 Multi-Agent 工作流,至少包含任务分配、状态持久化、错误重试、结果评估四个模块。框架用什么不重要,重要的是你能讲清楚每个设计决策背后的取舍。

第三层:建立评估体系(2-3 周,很多人跳过这里)

面试中最容易把人筛掉的不是不会写代码,而是回答不了这个问题:“你怎么衡量你的 Agent 系统的质量?”

你需要能回答:

- RAG 系统的 Recall、Precision 怎么测

- Agent 完成率(Task Completion Rate)怎么定义和追踪

- 用什么手段做 LLM 输出的质量监控(最低也得懂 LLM-as-Judge)

这一层考的就是工程判断力:你不只是会用工具,你知道怎么判断工具好不好用。面试官追问这一层,“会用框架"的候选人就答不上来。

四、关于 P6 还是 P7 的问题

面 P6 是正确选择,但别告诉面试官你只有 P6 的期望。

P7 的核心门槛不是技术深度,是架构决策能力——有没有在真实业务压力下拍板过技术方案、并对结果负责。这个靠自学绕不过去。

P6 的 AI Agent 岗位本来竞争就不激烈,因为多数候选人是"会用框架、不懂系统"的类型。面试官追问失败处理、评估体系、线上可观测性,大多数人答不上来。

你 6 年的工程经验,加上把上面三层真正做扎实,P6 是能拿到 strong hire 的评级的。

五、关于不背刺老板的事

你能提这个问题,职业成熟度是没问题的。

自学路线走完大概 3-4 个月,期间在公司内找 AI Agent 相关的项目练手是最高效的路径——不需要跳槽,真实业务场景的踩坑比什么自学项目都值钱。面试时这段经历也比个人 side project 更有说服力。

以上是我对这个问题的判断。具体到某个技术点有疑问,欢迎评论区讨论。