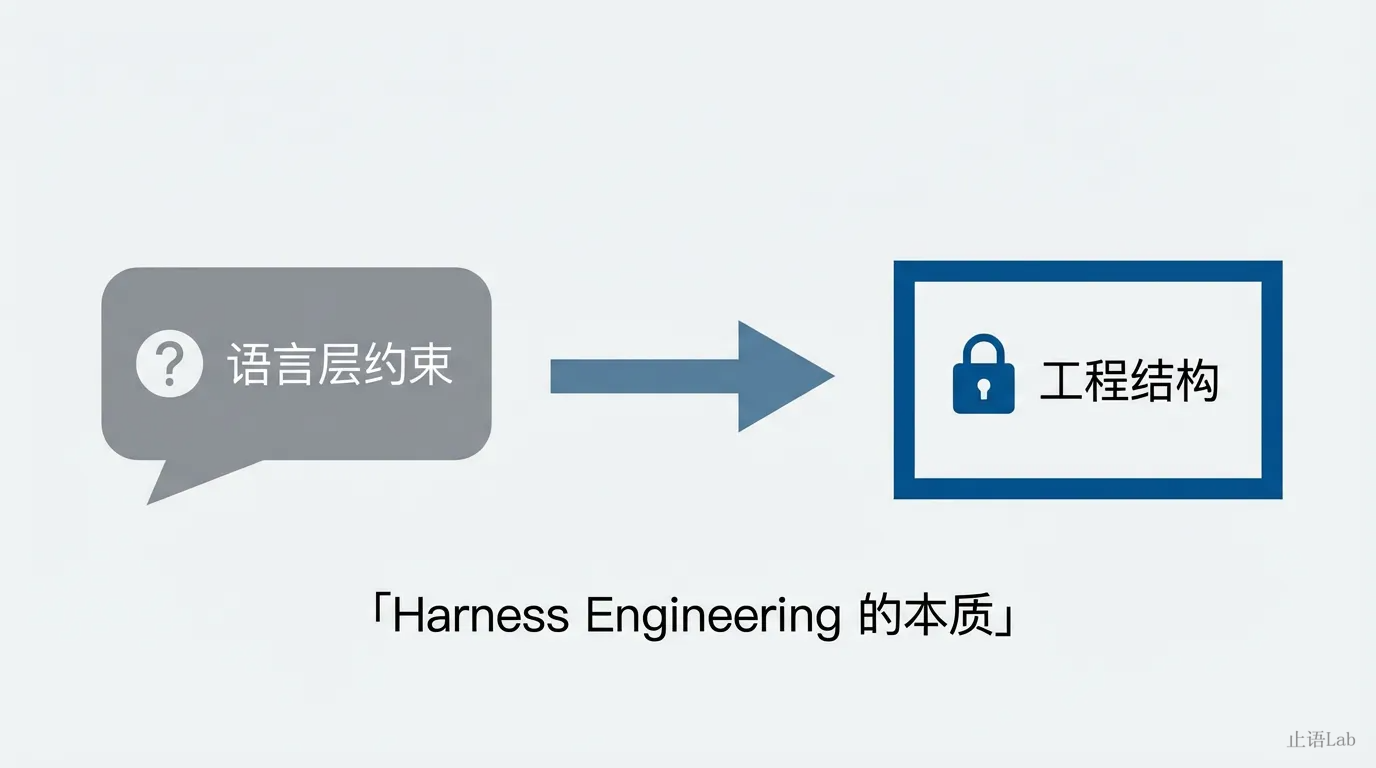

Harness Engineering 的本质,是把 AI 执行的"可信度问题"转化为"工程结构问题"。

很多人把 Harness 理解成"测试框架"或者"CI/CD 升级版",这个理解太窄了。也有人说它是"约束 AI 的工具",这个理解太浅了。

说具体点。

一、从一个真实的失败案例说起

我见过一个 AI Agent 的翻车现场——没有任何 Harness 的情况下,直接让 Agent 重构一个服务。

结果呢?AI 生成的代码能跑,但慢慢地把整个模块的命名规范搞乱了,引入了和项目架构完全不符的第三方库,而且因为没有边界,它还顺手改了几个"看起来相关"但不该碰的文件。

没有人在第一时间发现,因为测试全过了。

三周后,另一个工程师来维护,发现这块代码像是外星人写的。

这个问题的根源不是 AI 能力不够,而是我们没有告诉它"可信边界在哪里"。

二、Prompt Engineering 解决不了这个问题

你可能会说:那就写好 Prompt,让 AI 遵守规范。

试过。不管用。

原因很简单:Prompt 是柔性约束,AI 可以"理解但忽略"。当任务复杂、上下文窗口被塞满、或者模型换了一版,这些软约束就会悄悄失效。

Context Engineering 进了一步——它开始思考"给 AI 什么信息",但仍然没有解决执行的可验证性问题。AI 可以访问到结构化的上下文,但它做了什么、对不对,还是不可知的。

Harness Engineering 跨过了这道门槛,逻辑是:不要指望通过"说清楚"来控制 AI,要通过"结构"来限制 AI 的行动空间。

三、Harness 的三个核心支柱

1. 刚性边界(Hard Constraints)

不是 Prompt 里写"不要修改这个目录",而是文件系统权限本身就限制了写入。不是说"不要访问外网",而是沙箱环境里根本没有网络出口。

2. 自动反馈闭环(Automated Feedback Loop)

每次 AI 执行后,不靠人来判断对不对,而是有自动化的验证机制:单元测试、静态分析、lint 规则、架构合规扫描。这些不是事后检查,而是 Agent 工作流的一部分。

3. 可审计的执行轨迹(Auditable Execution)

AI 做了什么,必须有迹可查。不只是最终代码,是每一步的决策和工具调用。这是"可信度"的物质基础——你没法信任一个你看不见的黑箱。

四、本质是什么

Harness Engineering 是把"对 AI 生成内容的信任"从人工审核转移到工程结构上。

以前,AI 生成代码 → 人来看对不对 → 合格才能合并。 现在,AI 生成代码 → 系统自动验证 → 人只做最终裁决。

它不是"测试框架"的升级——它是软件工程中责任体系的重构。

OpenAI 那个 3 人团队 5 个月交付 100 万行代码的案例,不是因为 AI 变强了——模型能力那几个月变化不大。是因为他们搭了一套 Harness,让 AI 的每一步输出都有验证闭环,让工程师可以以最小的信任成本批量接受 AI 的产出。

五、一个判断

Harness Engineering 不会替代工程师,但它会改变工程师的工作重心:

从"写代码",转向"设计 AI 可以安全工作的结构"。

这件事比 Prompt 技巧难多了,也有价值得多。

欢迎讨论。